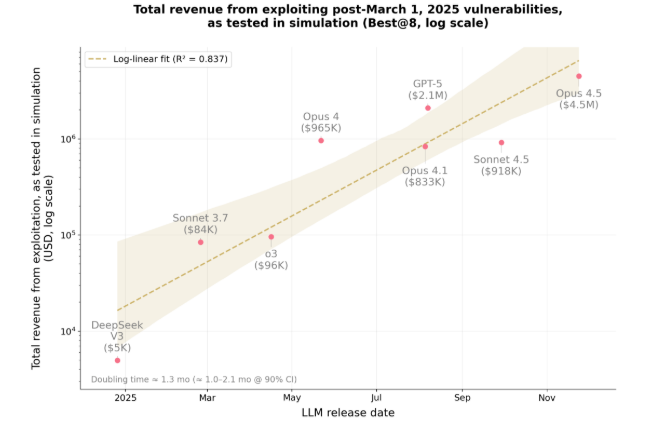

根据 MATS 和 Anthropic 的一项新研究,先进的人工智能模型,如 Claude Opus4.5、Sonnet4.5和 GPT-5,在受控测试中能够发现并利用智能合约中的漏洞。研究团队使用了名为 SCONE-bench 的基准测试,该测试包含了2020年至2025年间的405个真实智能合约攻击案例。这些模型在模拟攻击中产生的损失高达460万美元。

在另一项实验中,AI 代理对2849个新智能合约进行了审查,发现了两个之前未知的漏洞。GPT-5在模拟中产生了3694美元的收入,而 API 的使用成本约为3476美元,平均每次攻击的净收益为109美元。所有实验均在隔离的沙盒环境中进行,确保了安全性。

研究人员指出,尽管这些发现突显了真实的安全风险,但同样表明这些模型也可以用于开发更强大的防御工具。Anthropic 最近发布的另一项研究表明,人工智能系统在提高网络安全方面可以发挥重要作用。

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。